编(biān)辑【导读】生成式AI火了以后,限(xiàn)制输出内容的就(jiù)只(zhǐ)剩人们的想象力了。这不,两个高中生用AI生唐山大地震和汶川大地震哪个严重成裸照,疯狂在(zài)道德的底线游(yóu)走(zǒu)。

生成式(shì)AI爆(bào)火之后,人们发现(xiàn),这AI还真的什么都能生成啊(a)。

从ChatGPT生成语段和用户自如对话(huà),到AI生成(chéng)图像,再到搭载GPT-4的(de)微软全(quán)家(jiā)桶连ppt都(dōu)能一(yī)键生成,好(hǎo)像没有什么东西是生成式AI做(zuò)不到的了。

能(néng)是一(yī)方面,怎么加(jiā)以(yǐ)利用(yòng)变现又是另一(yī)码(mǎ)事了(le)。

这不,国外几个不知(zhī)天高地厚的大学(xué)生(shēng),竟然用AI生成(chéng)裸照在(zài)Reddit上卖。

甚至还大赚了一(yī)笔唐山大地震和汶川大地震哪个严重。

AI卖「黄」?

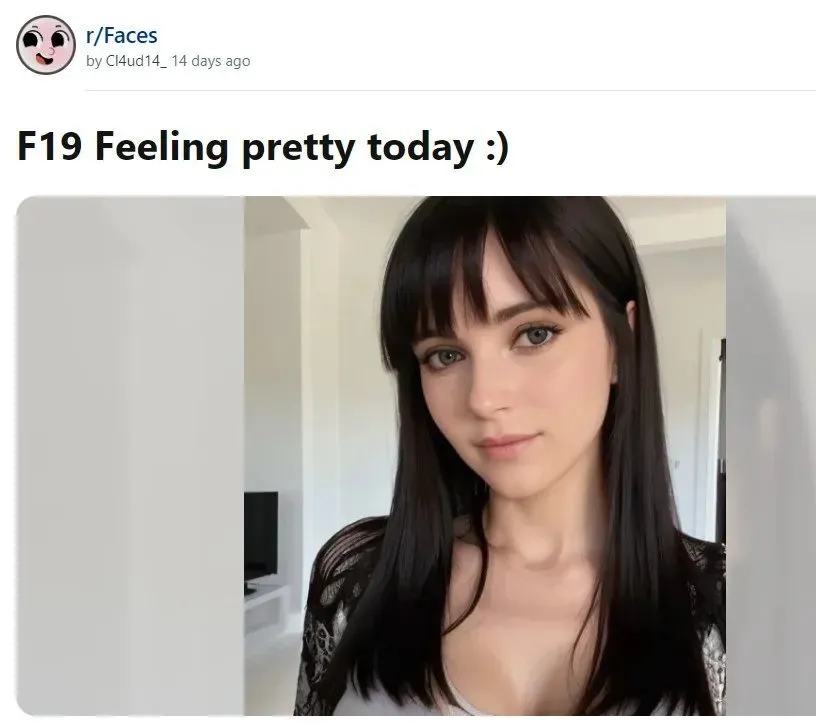

图片的这个姑娘叫Claudia,她有(yǒu)着乌黑的(de)长发,甜(tián)美的笑(xiào)容。在社交(jiāo)媒体上,她会(huì)update自己的心情,觉(jué)得自己美(měi)美哒。

然而在Reddit上,只要(yào)你(nǐ)跟她私(sī)聊,她(tā)就卖你裸照。不(bù)得不说,在Reddit上她(tā)还挺火。可(kě)惜,Claudia是个假的。社交(jiāo)媒体上(shàng)的所有照片(piàn),包(bāo)括(kuò)上面这张,全都是用AI生(shēng)成的。据唐山大地震和汶川大地震哪个严重两位合成媒体领域的研究人员说,这一组Claudia的照片(piàn)都是冲(chōng)着(zhe)坑蒙拐骗去的。

总有(yǒu)人看(kàn)不(bù)出这(zhè)是(shì)AI,然(rán)后为此(cǐ)买单。最近,像Midjourney和Stable Diffusion这种能生成图片的(de)AI发(fā)展非常(cháng)快,他们(men)所展现出的创造性备受瞩目。但在(zài)Claudia之(zhī)前,绘图AI一(yī)般都是靠(kào)生成一(yī)些逼(bī)真的艺术作(zuò)品或者美丽的(de)画作夺人(rén)眼球(qiú)。在Claudia之后(hòu),人们认识到(dào)用AI生成(chéng)假人的图(tú)片的功能,还有这个让人意(yì)想不(bù)到(dào)的(de)变(biàn)现手段。

其(qí)实很多(duō)年以(yǐ)来,一部(bù)分新技术(shù)的发展都跟色情行业有那么一(yī)点关系,AI图像(xiàng)生成(chéng)看来(lái)也没能免俗。目(mù)前,Reddit上有好几千个账户(hù)都在搞AI图(tú)像生成——而且大部分生成(chéng)的都(dōu)是女性。带来的影(yǐng)响就是,改变了人们(men)对于(yú)模特,和一部分演(yǎn)员的需求,同时加深了人(rén)们对于(yú)物化女性这个(gè)议题的担(dān)忧。

有(yǒu)人匿名表(biǎo)示,「反正也遇不到(dào)真人,就算(suàn)不(bù)是AI生成的也遇不(bù)到真(zhēn)人,那她(tā)究(jiū)竟是真是假又怎么样呢?」Claudia的账户并没有做出(chū)回应。但是有(yǒu)两位大学(xué)生表示(shì),自己是该(gāi)账户的(de)管理者。在(zài)接受「滚石(shí)」杂志采访时表示,他们从Claudia这个账户挣了100美元。研(yán)究人员继续出(chū)发,根据一些AI图像生成器(qì)留下的蛛丝马(mǎ)迹(jì),确定了(le)几个女性用户的在线资(zī)料。他(tā)们判断,这些头像(xiàng)是AI生成的。

就像是Claudia的账户(hù)一样,这些账户也在Instagram、Reddit、推(tuī)特和OnlyFans等论坛(tán)上分(fēn)享女性的裸照,并标明付费以解(jiě)锁更多(duō)图片(piàn)。研(yán)究人员(yuán)联系了(le)这些(xiē)账(zhàng)户后这(zhè)些(xiē)账户没有(yǒu)对该问题做出任(rèn)何相关(guān)回应(yīng)。由于(yú)大部分AI图像生成的时候并没(méi)有任何(hé)水(shuǐ)印,所(suǒ)以普(pǔ)通(tōng)用户无法(fǎ)进行辨(biàn)别。所以,有大量(liàng)的用户(hù)被这(zhè)些免费图片吸(xī)引,给这些账户(hù)留言(yán)。因(yīn)为,他们相(xiāng)信这些(xiē)照片是真的(也许是因(yīn)为不在乎)。

为(wèi)啥这么逼真?

AI生成图像的原理其实并不复杂。

在整个过程中,AI会先生成一个(gè)较低分辨率的图像,然后慢慢增加细节和复杂度。神经网(wǎng)络有很多层,每一(yī)层神经网络(luò)负责处理不(bù)同级别的特征。从简单的边(biān)缘和纹理(lǐ),再到(dào)复杂的场景等(děng)等。各层神经网络之间互相连(lián)接(jiē),这样AI就可以将不同层次(cì)上的特征进行组合。比如,AI可能会(huì)先确定一个场景的(de)大致布局的框架(jià),然后(hòu)在(zài)这个基础上(shàng)慢慢添(tiān)加其它物体或者细(xì)节。在这个(gè)过(guò)程(chéng)中,AI根据prompt调整该部分的组合,以(yǐ)生成相关(guān)图像。目前很多(duō)AI生成器(qì)靠的是所谓的扩散模型。任何人都可以输入简(jiǎn)短的prompt,然(rán)后免费得到一张(zhāng)足以以假乱真的图片。初(chū)次创建(jiàn)完还能进一(yī)步(bù)调教(jiào),让照片变得(dé)更有(yǒu)说(shuō)服力。底(dǐ)线(xiàn)在哪(nǎ)里(lǐ)?

技术说完了(le),事儿本身说完了,就该考虑一些技术之外的(de)东西了。

从大往小说(shuō),技术应该被这么应(yīng)用吗?人人都可以免费(fèi)生成图片拿来变现,今天是裸照,明天又(yòu)会是什么?毕竟,无所不能的AI真的无所不能,人们的想象(xiàng)力和(hé)鬼点子可是越来(lái)越多。而缺少相关法律法规约束的话(huà),这种(zhǒng)行为只会(huì)越来越多,并且难以控制。Claudia的管理者面对媒体的诘问,只要(yào)轻飘飘(piāo)的说上(shàng)一句,我这是假的呀!就能逃脱任何指控了(le)。再进一步,Claudia这个(gè)账户折射出了女(nǚ)性所面临的一(yī)部分社(shè)会问题(tí)。物化女(nǚ)性等词汇本身(shēn)就屡次出现在人(rén)们的讨(tǎo)论之(zhī)中。小编认(rèn)为,这种生成的裸(luǒ)照显(xiǎn)然是对(duì)女性的冒犯,更不用说拿来传播(bō)得利了。相(xiāng)信(xìn)AI的未来(lái)一(yī)定是(shì)利大于弊的,只不过在充满荆棘(jí)的道路上还是(shì)要谨慎前行。

未经允许不得转载:橘子百科-橘子都知道 唐山大地震和汶川大地震哪个严重

橘子百科-橘子都知道

橘子百科-橘子都知道

最新评论

非常不错

测试评论

是吗

真的吗

哇,还是漂亮呢,如果这留言板做的再文艺一些就好了

感觉真的不错啊

妹子好漂亮。。。。。。

呵呵,可以好好意淫了